Indul a második menet Irán ellen - exkluzív Hetek-fórum és nézői kérdések

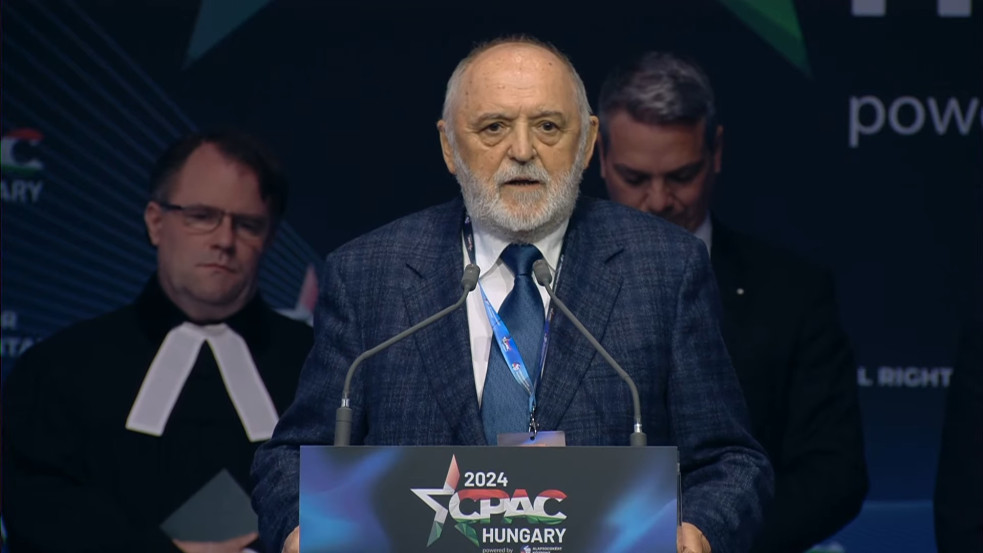

Németh Sándor a CPAC-en: „A konzervatív erők céljai megegyeznek Isten céljaival”

Egyházi vezetők, köztük Németh Sándor, a Hit Gyülekezete vezető lelkésze is felszólalt a mai nappal elstartolt CPAC-en (Konzervatív Politikai Akció Konferencia - Conservative Political Action Conference), mely a legnagyobb nemzetközi konzervatív csoportok találkozója és bemutatója.

Hírdetés

Hírdetés

hetilap

hetilap

Fordulópont? Itt a bizonyíték pubertásblokkolók károsságáról

Április 10-én hozták nyilvánosságra dr. Hilary Cass jelentését a nemi identitásukat megkérdőjelező gyermekeknek nyújtott brit egészségügyi szolgáltatásokról. A független vizsgálat megállapította, hogy nincs bizonyíték az eddigi protokoll hatékonyságára, ami várhatóan józanabb mederbe tereli az ezzel kapcsolatos vitát, és véget vethet a fiatalokat egy életre tönkre tevő, elhamarkodott kezeléseknek.

hetilap

hetilap

Interjú a hátizsákos hőssel, aki nekiment a játszótéren késelő terroristának

Tavaly júniusban egy késsel felfegyverzett szír állampolgár gyerekekre támadt egy játszótéren. Négy gyermek súlyosan megsérült, majd a támadó folytatta volna ámokfutását, ha többen nem lépnek közbe a rendõrség érkezése elõtt. Köztük volt a 25 éves Henri d’Anselme is, aki most a Nemzeti Közszolgálati Egyetem konferenciáján igyekezett szakértõk segítségével megfejteni, meg tudja-e menteni a kereszténység Európát.

Videók

hetilap

hetilap

Elképesztő cenzúra: így lehetetlenítik el a konzervatív médiumokat

A cenzúra egyre változatosabb eszközeinek alkalmazására derül fény – az alternatív véleményeket megfogalmazó felhasználók közösségimédia-platformokról való kitiltása után most itt vannak a reklámbevételek elapasztásával operáló startupok, az ún. minősítő ügynökségek. Természetesen ezek sem függetlenek.

hetilap

hetilap

Csupán illúzió a globális béke?

A nemzetet már a modern nemzetállamok 19. századi berobbanása előtt támadták a felvilágosodás gondolkodói, kijelölve ezzel korunk egyre megkérdőjelezhetetlenebbé szilárduló globalizmusának filozófiai kereteit. Ily módon egy globális rezsim létrehozása a „tiszta ész” parancsa, holott csupán az ősi birodalomépítő szándék egy alaposabban átgondolt megnyilvánulásáról van szó.

hetilap

hetilap

Így válnak influencerek játékszerévé a fiatalok

A Z generáció bevallása szerint a valaha élt legmagányosabb nemzedék, és rosszabb egészségi állapotban van, mint az idősebb generációk. Gary Chapman szerint soha nem késő beavatkozni, hogy gyermekeink képesek legyenek jó emberi kapcsolatokban élni, és ne váljanak influenszerek játékszerévé vagy online kihívások áldozatává.

hetilap

hetilap

Zsidómentes zónák: hogy jutottak idáig az amerikai elitegyetemek?

A felszín alatt régóta fortyogó feszültség robbant ki a múlt héten az Egyesült Államok több egyetemén, köztük a Columbián, ahol a kialakult helyzet miatt online oktatást rendeltek el. Joe Biden elítélte az egyetemeken tomboló antiszemitizmust, a főáramú média és a baloldali politikusok viszont békésnek nevezték a tüntetéseket, amelyek helyszínét a campusokon felszabadított, „Judenrein” területnek nevezték a résztvevők.

Hírdetés

Hírdetés